Dlaczego warto rozwijać offline asystenta AI

Tworzenie offline asystenta AI to nie tylko kwestia technologii, ale także prywatności i efektywności. Instalacja bibliotek takich jak TensorFlow czy PyTorch jest niezbędna, aby rozpocząć pracę nad modelem. Dzięki nim możemy zyskać pełną kontrolę nad danymi oraz zmniejszyć zużycie energii, co jest istotne w kontekście ochrony środowiska. Wybierając odpowiednie narzędzia, jak TensorFlow i PyTorch, można znacznie poprawić wydajność lokalnych procesów.

Instalacja PyTorch na Windowsie

Przygotowanie systemu

PyTorch, jako jedna z najczęściej wybieranych bibliotek do uczenia maszynowego, jest kluczowym elementem w tworzeniu offline modeli językowych. Instalacja może wydawać się złożona, ale krok po kroku staje się przystępna. Najpierw upewnij się, że masz zainstalowaną najnowszą wersję Pythona. Następnie, użyj pip, aby pobrać niezbędne pakiety.

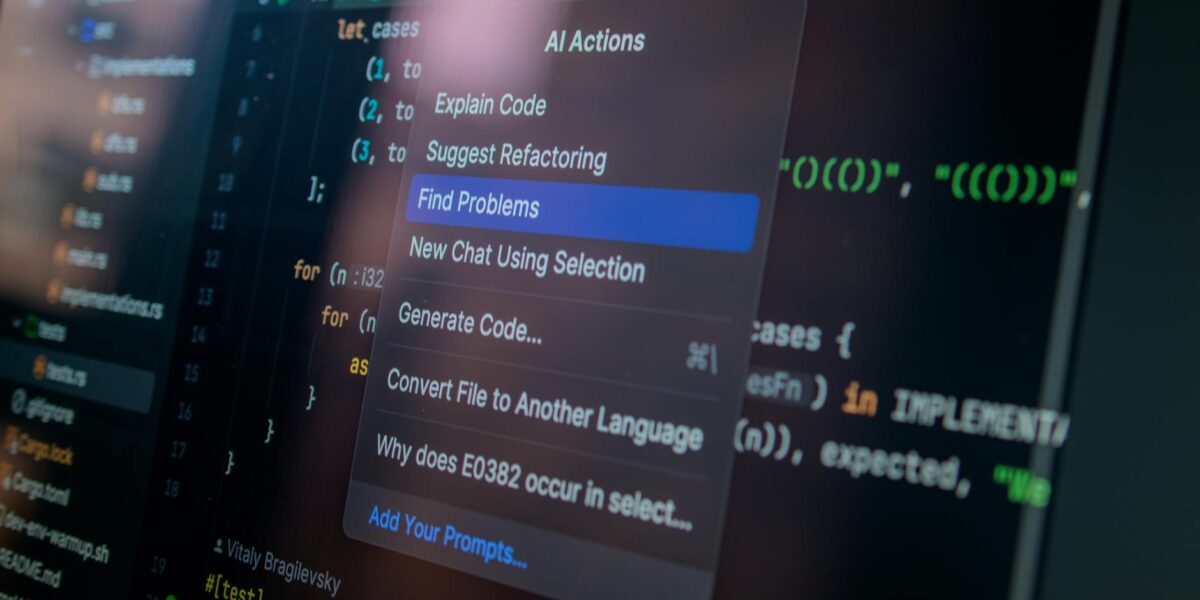

Instalacja krok po kroku

Rozpocznij od otwarcia wiersza poleceń i wpisz: pip install torch torchvision. To umożliwi instalację PyTorch i dodatkowych narzędzi do pracy z obrazami. Jeśli napotkasz problemy, zajrzyj do dokumentacji na oficjalnej stronie PyTorch, gdzie znajdziesz szczegółowe wskazówki.

Jak zbudować AI na telefonie bez internetu?

Wybór odpowiednich narzędzi

Tworzenie asystenta AI na urządzenia mobilne bez dostępu do internetu to wyzwanie, które wymaga przemyślanej strategii i odpowiednich narzędzi. Warto rozważyć użycie TensorFlow Lite, które jest zoptymalizowane do działania na urządzeniach o ograniczonej mocy obliczeniowej.

Krok po kroku

Najpierw skonfiguruj środowisko deweloperskie, a następnie wybierz model, który chcesz zastosować. TensorFlow Lite oferuje różnorodne modele, które można łatwo dostosować do różnych zadań, od rozpoznawania mowy po przetwarzanie obrazu. Po zaimplementowaniu modelu, testuj jego działanie w różnych warunkach, aby upewnić się, że spełnia twoje oczekiwania.

Porównanie modelu językowego offline

TensorFlow kontra PyTorch

Wybór między TensorFlow a PyTorch zależy od wielu czynników. TensorFlow oferuje bardziej rozbudowane narzędzia do wdrażania modeli na urządzeniach mobilnych, ale PyTorch jest często preferowany przez naukowców za swoją prostotę i elastyczność. Wybór odpowiedniego modelu językowego jest kluczowym krokiem w budowie asystenta AI działającego bez połączenia internetowego.

Przykłady zastosowań

Na przykład, Amazon DeepFleet AI, które wdrożyło milionowego robota w 2026 roku, poprawiło efektywność podróży po magazynie o 10 procent, co pokazuje potencjał lokalnych systemów AI. Podobnie, IKEA Place App, aplikacja AR/VR, zredukowała zwroty mebli o 25 procent w pierwszym roku użytkowania. To pokazuje, jak różne modele mogą być dostosowane do specyficznych potrzeb.

Co zrobić, gdy Ollama crashuje?

Jeśli napotkasz problemy z Ollama, warto upewnić się, że środowisko jest poprawnie skonfigurowane. Często problemy wynikają z niekompatybilnych wersji bibliotek lub błędów w kodzie. Sprawdź dokumentację i fora, gdzie użytkownicy dzielą się doświadczeniami i rozwiązaniami podobnych problemów. Czasami wystarczy aktualizacja jednego komponentu, aby rozwiązać problem.

Źródła: [crn.pl], [domena2.com], [domena3.pl]